Коефіцієнт кореляції економіки показує. Коефіцієнт кореляції. Поняття про помилковість кореляції

У математичній статистиці кореляцією є статистична і ймовірнісна залежність, яка не має суворого функціонального характеру. Кореляційна залежність у тому випадку, коли одне із ознак залежить як від даного другого, і від низки інших випадкових чинників. Коефіцієнт кореляції служить математичною мірою залежності двох випадкових величин.

Види коефіцієнтів кореляції можуть бути негативними та позитивними. Розрахунки, виконувані з допомогою кореляції, є дуже складними, але вимагають особливої уважності від виконавця при розрахунках. За цих обчислень вам обов'язково знадобиться інженерний калькулятор. Перш ніж з'ясувати, як знайти коефіцієнт кореляції, необхідно усвідомити значення значень коефіцієнтів:

- У тому випадку, коли значення по модулю розташовується ближче до 1, це прямий показник наявності сильного зв'язку.

- Якщо ж значення знаходиться ближче до 0, то це вже означає слабкий зв'язок або взагалі його відсутність.

- Коли коефіцієнт кореляції дорівнює 1, тоді йдеться про функціональний зв'язок, що свідчить про можливість опису за допомогою математичної функції зміни двох величин.

Порядок та метод розрахунку коефіцієнта кореляції

Знайти вибірковий коефіцієнт кореляції можна двома методами:

- ранговий метод, або метод Спірмена,

- метод квадратів, чи метод Пірсона.

Ранговий метод

Ранговий метод полягає в наступному алгоритмі дій:

- Потрібно скласти два ряди, що складаються з парних ознак. У цьому вводимо такі позначення: перший ряд – x і другий ряд – у. Перший ряд ознаки необхідно представити у зростаючому або спадному порядку. Числові значення другого ряду розташовуємо навпроти значень першого ряду.

- Потім у кожному з рядів порівняння замінюємо порядковим номером (рангом) величину ознаки. Номерами (рангами) позначаються місця показників, або значень першого і другого рядів. А числовим значенням другої ознаки повинні присвоюватися ранги абсолютно в такому самому порядку, як і при роздачі першої ознаки їх величин. Необхідно врахувати, що й ознака у ряді має однакові величини, то ранги необхідно визначати як середнього числа із суми порядкових номерів даних величин.

- Далі визначаємо різницю рангів між показниками: (d) = х-у.

- Після цього зводимо в квадрат отриману різницю рангів (d 2).

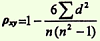

- І на закінчення отримуємо суму квадратів різниці, після чого підставляємо всі отримані значення в наступну формулу: Pxy=1-(6 ?d 2)/n(n 2 -1).

Метод квадратів

Метод квадратів включає наступний алгоритм:

- Для того щоб знайти коефіцієнт кореляції спочатку необхідно побудувати для кожного з порівнянних ознак варіаційні ряди. Позначаємо перший ряд – х та другий ряд – у. Тепер визначаємо середні значення (М1 і М2) для кожного варіаційного ряду.

- Далі знаходимо відхилення кожного числового значення (d х та d y) від середнього значення ряду.

- Перемножуємо отримані відхилення і зводимо кожне відхилення квадрат, після чого підсумовуємо по кожному ряду.

- Потім необхідно підставити всі отримані раніше значення формулу і в такий спосіб знайти коефіцієнт кореляції: r xy = ?(dx*dy)/(sqrt(? d2x)*? d2y).

- Якщо є обчислювальна техніка, то розрахунок можна зробити за такою формулою, також цю форму розрахунку можна використовувати в програмах, написаних мовою Паскаль: r xy =(nƩxy-/Ʃx *Ʃy)/(sqrt(- )).

При вивченні громадського здоров'я та охорони здоров'я в наукових та практичних цілях досліднику часто доводиться проводити статистичний аналіз зв'язків між факторними та результативними ознаками статистичної сукупності (причинно-наслідковий зв'язок) або визначення залежності паралельних змін кількох ознак цієї сукупності від якоїсь третьої величини (від загальної їх причини ). Необхідно вміти вивчати особливості цього зв'язку, визначати його розміри та напрямок, а також оцінювати його достовірність. І тому використовуються методи кореляції.

- Види прояву кількісних зв'язків між ознаками

- функціональний зв'язок

- кореляційний зв'язок

- Визначення функціонального та кореляційного зв'язку

Функціональний зв'язок- такий вид співвідношення між двома ознаками, коли кожному значення одного з них відповідає строго певне значення іншого (площа кола залежить від радіуса кола і т.д.). Функціональний зв'язок притаманний фізико-математичних процесів.

Кореляційний зв'язок- такий зв'язок, при якому кожному певному значенню однієї ознаки відповідає кілька значень іншої взаємопов'язаної з ним ознаки (зв'язок між зростанням та масою тіла людини; зв'язок між температурою тіла та частотою пульсу та ін.). Кореляційний зв'язок й у медико-биологических процесів.

- Практичне значення встановлення кореляційного зв'язку. Виявлення причинно-наслідкової між факторними та результативними ознаками (при оцінці фізичного розвитку, Для визначення зв'язку між умовами праці, побуту та станом здоров'я, при визначенні залежності частоти випадків хвороби від віку, стажу, наявності виробничих шкідливостей та ін.)

Залежність паралельних змін кількох ознак від якоїсь третьої величини. Наприклад, під впливом високої температури у цеху відбуваються зміни кров'яного тиску, в'язкості крові, частоти пульсу та ін.

- Величина, що характеризує напрям та силу зв'язку між ознаками. Коефіцієнт кореляції, який одним числом дає уявлення про спрямування та силу зв'язку між ознаками (явленнями), межі його коливань від 0 до ± 1

- Способи подання кореляційного зв'язку

- графік (діаграма розсіювання)

- коефіцієнт кореляції

- Напрямок кореляційного зв'язку

- пряма

- зворотна

- Сила кореляційного зв'язку

- сильна: ±0,7 до ±1

- середня: ±0,3 до ±0,699

- слабка: 0 до ±0,299

- Методи визначення коефіцієнта кореляції та формули

- метод квадратів (метод Пірсона)

- ранговий метод (метод Спірмена)

- Методичні вимоги щодо використання коефіцієнта кореляції

- вимір зв'язку можливий тільки в якісно однорідних сукупностях (наприклад, вимірювання зв'язку між зростанням і вагою в сукупностях, однорідних за статтю та віком)

- розрахунок може здійснюватися з використанням абсолютних чи похідних величин

- для обчислення коефіцієнта кореляції використовуються не згруповані варіаційні ряди (ця вимога застосовується лише при обчисленні коефіцієнта кореляції за методом квадратів)

- кількість спостережень не менше 30

- Рекомендації щодо застосування методу рангової кореляції (метод Спірмена)

- коли немає необхідності в точному встановленні сили зв'язку, а достатньо орієнтовних даних

- коли ознаки представлені не лише кількісними, а й атрибутивними значеннями

- коли ряди розподілу ознак мають відкриті варіанти (наприклад, стаж роботи до 1 року та ін.)

- Рекомендації щодо застосування методу квадратів (метод Пірсона)

- коли потрібне точне встановлення сили зв'язку між ознаками

- коли ознаки мають лише кількісний вираз

- Методика та порядок обчислення коефіцієнта кореляції

1) Метод квадратів

2) Ранговий метод

- Схема оцінки кореляційного зв'язку за коефіцієнтом кореляції

- Обчислення помилки коефіцієнта кореляції

- Оцінка достовірності коефіцієнта кореляції, отриманого методом рангової кореляції та методом квадратів

Спосіб 1

Достовірність визначається за такою формулою:

Критерій t оцінюється за таблицею значень t з урахуванням числа ступенів свободи (n – 2), де n – число парних варіантів. Критерій t повинен дорівнювати або більше табличного, що відповідає ймовірності р ≥99%.

Спосіб 2

Достовірність оцінюється за спеціальною таблицею стандартних коефіцієнтів кореляції. При цьому достовірним вважається такий коефіцієнт кореляції, коли за певної кількості ступенів свободи (n - 2) він дорівнює або більше табличного, відповідного ступеня безпомилкового прогнозу р ≥95%.

Завдання:обчислити коефіцієнт кореляції, визначити напрямок і силу зв'язку між кількістю кальцію у воді та жорсткістю води, якщо відомі такі дані (табл. 1). Оцінити достовірність зв'язку. Зробити висновок.

Таблиця 1

Обґрунтування вибору методу.Аби вирішити завдання обрано метод квадратів (Пірсона), т.к. кожна з ознак (жорсткість води та кількість кальцію) має числове вираження; немає відкритих варіантів.

Рішення.

Послідовність розрахунків викладено у тексті, результати представлені у таблиці. Побудувавши ряди з парних зіставних ознак, позначити їх через х (жорсткість води в градусах) і через у (кількість кальцію у воді в мг/л).

| Жорсткість води (у градусах) |

Кількість кальцію у воді (мг/л) |

d х | d у | d х х d у | d x 2 | d y 2 |

| 4 8 11 27 34 37 |

28 56 77 191 241 262 |

-16 -12 -9 +7 +14 +16 |

-114 -86 -66 +48 +98 +120 |

1824 1032 594 336 1372 1920 |

256 144 81 49 196 256 |

12996 7396 4356 2304 9604 14400 |

| М х = Σ х/n | М у = Σ у / n | Σ d х x d у =7078 | Σ d х 2 = 982 | Σ d y 2 = 51056 | ||

| М х = 120/6 = 20 | М y = 852/6 = 142 | |||||

- Визначити середні величини M x ряду варіант "х" і М у ряді варіант "у" за формулами:

М х = Σх/n (графа 1) та

М у = Σу/n (графа 2) - Знайти відхилення (d х і d у) кожної варіанти від величини обчисленої середньої в ряду "x" та в ряді "у"

d х = х – М х (графа 3) та d y = у – М у (графа4). - Знайти добуток відхилень d x х d y та підсумувати їх: Σ d х х d у (графа 5)

- Кожне відхилення d x і d у звести в квадрат і підсумовувати їх значення по ряду "х" і по ряду "у": d x 2 = 982 (графа 6) і d y 2 = 51056 (графа 7).

- Визначити добуток Σ d x 2 х Σ d y 2 та з цього твору витягти квадратний корінь

- Отримані величини Σ (d x x d y) та √ (Σd x 2 x Σd y 2)підставляємо у формулу розрахунку коефіцієнта кореляції:

- Визначити достовірність коефіцієнта кореляції:

1-й спосіб. Знайти помилку коефіцієнта кореляції (mr xy) та критерій t за формулами:

Критерій t = 14,1, що відповідає можливості безпомилкового прогнозу р > 99,9%.

2-й спосіб. Достовірність коефіцієнта кореляції оцінюється за таблицею " Стандартні коефіцієнти кореляції " (див. додаток 1). При числі ступенів свободи (n - 2) = 6 - 2 = 4 наш розрахунковий коефіцієнт кореляції r xу = + 0,99 більше табличного (r табл = + 0,917 при р = 99%).

Висновок.Чим більше кальцію у воді, тим вона жорсткіша (зв'язок пряма, сильна та достовірна: r ху = + 0,99, р> 99,9%).

на застосування рангового методуЗавдання:методом рангів встановити напрямок і силу зв'язку між стажем роботи в роках та частотою травм, якщо отримані такі дані:

Обґрунтування вибору методу:на вирішення завдання можна вибрати лише метод рангової кореляції, т.к. Перший ряд ознаки "стаж роботи у роках" має відкриті варіанти (стаж роботи до 1 року та 7 і більше років), що не дозволяє використовувати для встановлення зв'язку між зіставлюваними ознаками точніший метод - метод квадратів.

Рішення. Послідовність розрахунків викладено у тексті, результати представлені у табл. 2.

Таблиця 2

Стаж роботи у роках Число травм Порядкові номери (ранги) Різниця рангів Квадрат різниці рангів X Y d(х-у) d 2 До 1 року 24 1 5 -4 16 1-2 16 2 4 -2 4 3-4 12 3 2,5 +0,5 0,25 5-6 12 4 2,5 +1,5 2,25 7 і більше 6 5 1 +4 16 Σ d 2 = 38,5

Стандартні коефіцієнти кореляції, що вважаються достовірними (за Л.С. Камінським)

Число ступенів свободи - 2 Рівень ймовірності р (%) 95% 98% 99% 1 0,997 0,999 0,999 2 0,950 0,980 0,990 3 0,878 0,934 0,959 4 0,811 0,882 0,917 5 0,754 0,833 0,874 6 0,707 0,789 0,834 7 0,666 0,750 0,798 8 0,632 0,716 0,765 9 0,602 0,885 0,735 10 0,576 0,858 0,708 11 0,553 0,634 0,684 12 0,532 0,612 0,661 13 0,514 0,592 0,641 14 0,497 0,574 0,623 15 0,482 0,558 0,606 16 0,468 0,542 0,590 17 0,456 0,528 0,575 18 0,444 0,516 0,561 19 0,433 0,503 0,549 20 0,423 0,492 0,537 25 0,381 0,445 0,487 30 0,349 0,409 0,449 - Власов В.В. Епідеміологія. - М: ГЕОТАР-МЕД, 2004. - 464 с.

- Лісіцин Ю.П. Громадське здоров'я та охорона здоров'я. Підручник для вишів. – М.: ГЕОТАР-МЕД, 2007. – 512 с.

- Медик В.А., Юр'єв В.К. Курс лекцій з громадського здоров'я та охорони здоров'я: Частина 1. Суспільне здоров'я. – М.: Медицина, 2003. – 368 с.

- Міняєв В.А., Вишняков Н.І. та ін Соціальна медицина та організація охорони здоров'я (Посібник у 2 томах). – СПб, 1998. –528 с.

- Кучеренко В.З., Агарков Н.М. та ін. Соціальна гігієна та організація охорони здоров'я ( Навчальний посібник) – Москва, 2000. – 432 с.

- С. Гланц. Медико-біологічна статистика Пер з англ. – М., Практика, 1998. – 459 с.

06.06.2018 16 235 0 Ігор

Психологія та суспільство

Все у світі взаємопов'язане. Кожна людина на рівні інтуїції намагається знайти взаємозв'язки між явищами, щоб мати можливість впливати на них та керувати ними. Поняття, яке відбиває цей взаємозв'язок, називається кореляцією. Що вона означає простими словами?

Зміст:

Поняття кореляції

Кореляція (від латинського "correlatio" - співвідношення, взаємозв'язок)– математичний термін, що означає міру статистичної імовірнісної залежності між випадковими величинами (змінними).

Приклад:візьмемо два види взаємозв'язку:

- Перший- Ручка в руці людини. В яку сторону рухається рука, в таку сторону і ручка. Якщо рука перебуває у стані спокою, те й ручка нічого очікувати писати. Якщо людина трохи сильніше натисне на неї, то слід на папері буде більш насиченим. Такий вид взаємозв'язку відбиває жорстку залежність і є кореляційним. Це взаємозв'язок – функціональний.

- Другий вигляд– залежність між рівнем освіти людини та прочитанням літератури. Заздалегідь невідомо, хто з людей читає: вищою освітоючи без нього. Цей зв'язок – випадковий чи стохастичний, його вивчає статистична наука, яка займається виключно масовими явищами. Якщо статистичний розрахунок дозволить довести кореляційний зв'язок між рівнем освіченості та прочитанням літератури, це дасть можливість робити будь-які прогнози, передбачати ймовірнісний наступ подій. У цьому прикладі з великою ймовірністю можна стверджувати, що більше читають книги люди з вищою освітою, ті, хто більш освічений. Але оскільки зв'язок між цими параметрами не функціональний, ми можемо і помилитися. Завжди можна розрахувати можливість такої помилки, яка буде однозначно невелика і називається рівнем статистичної значущості (p).

Прикладами взаємозв'язку між природними явищамиє:ланцюжок харчування у природі, організм людини, що складається із систем органів, взаємопов'язаних між собою та функціонуючих як єдине ціле.

Щодня ми стикаємося з кореляційною залежністю у повсякденному житті: між погодою та гарним настроєм, правильним формулюванням цілей та їх досягненням, позитивним настроєм та везінням, відчуттям щастя та фінансовим благополуччям. Але ми шукаємо зв'язку, спираючись не на математичні розрахунки, а на міфи, інтуїцію, забобони, пусті домисли. Ці явища дуже складно перекласти математичною мовою, висловити в цифрах, виміряти. Інша річ, коли ми аналізуємо явища, які можна прорахувати, у вигляді цифр. У такому разі ми можемо визначити кореляцію за допомогою коефіцієнта кореляції (r), що відображає силу, ступінь, тісноту та напрямок кореляційного зв'язку між випадковими змінними.

Сильна кореляція між випадковими величинами– свідчення наявності деякої статистичної зв'язку саме між цими явищами, але це зв'язок неспроможна переноситися на ті самі явища, але в інший ситуации. Часто дослідники, отримавши у розрахунках значну кореляцію між двома змінними, виходячи з простоті кореляційного аналізу, роблять помилкові інтуїтивні припущення існування причинно-наслідкових взаємозв'язків між ознаками, забуваючи у тому, що коефіцієнт кореляції носить імовірнісний характер.

Приклад:кількість травмованих під час ожеледиці та кількість ДТП серед автотранспорту. Ці величини корелюватимуть між собою, хоча вони абсолютно не взаємопов'язані між собою, а мають тільки зв'язок із загальною причиною цих випадкових подій – ожеледицею. Якщо ж аналіз не виявив кореляційного взаємозв'язку між явищами, це ще не є свідченням відсутності залежності між ними, яка може бути складною нелінійною, яка не виявляється за допомогою кореляційних розрахунків.

Першим, хто ввів у науковий обіг поняття кореляції, був французький палеонтолог Жорж Кюв'є. Він у XVIII столітті вивів закон кореляції елементів та органів живих організмів, завдяки якому з'явилася можливість відновлювати по знайденим частинам тіла (останкам) вигляд усієї копалини істоти, тварини. У статистиці термін кореляції вперше застосував 1886 року англійський учений Френсіс Гальтон. Але він не зміг вивести точну формулу для розрахунку коефіцієнта кореляції, але це зробив його студент. найвідоміший математик та біолог Карл Пірсон.

Види кореляції

За значимістю- Високозначна, значуща і незначна.

|

Види |

чому дорівнює r |

|

Високозначна |

r відповідає рівню статистичної значущості p<=0,01 |

|

Значна |

r відповідає p<=0,05 |

|

Незначна |

r не досягає p>0,1 |

Негативна(Зменшення значення однієї змінної веде до зростання рівня іншої: чим більше у людини фобій, тим менша ймовірність обійняти керівну посаду) і позитивна (якщо зростання однієї величини тягне за собою збільшення рівня іншої: чим більше нервуєшся, тим більша ймовірність захворіти). Якщо зв'язку між змінними немає, тоді така кореляція називається нульовою.

Лінійна(коли одна величина зростає чи зменшується, друга теж збільшується чи зменшується) і нелінійна (коли за зміни однієї величини характер зміни другий неможливо описати з допомогою лінійної залежності, тоді застосовуються інші математичні закони – поліноміальної, гиперболической залежності).

За силою.

Коефіцієнти

Залежно від того, до якої шкали відносяться змінні, що досліджуються, розраховуються різні види коефіцієнтів кореляції:

- Коефіцієнт кореляції Пірсона, коефіцієнт парної лінійної кореляції або кореляція моментів творів розраховується для змінних з інтервальною та кількісною шкалою виміру.

- Коефіцієнт рангової кореляції Спірмена або Кендалла - коли хоча б одна з величин має порядкову шкалу або не є нормально розподіленою.

- Коефіцієнт точкової дворядної кореляції (коефіцієнт кореляції знаків Фехнера) – якщо одна з двох величин є дихотомічною.

- Коефіцієнт чотирипольової кореляції (коефіцієнт множинної рангової кореляції (конкордації) – якщо дві змінні дихотомічні.

Коефіцієнт Пірсона належить до параметричних показників кореляції, решта – до непараметричним.

Значення коефіцієнта кореляції знаходиться у межах від -1 до +1. За повної позитивної кореляції r = +1, за повної негативної – r = -1.

Формула та розрахунок

Приклади

Необхідно визначити взаємозв'язок двох змінних: рівня інтелектуального розвитку (за даними проведеного тестування) та кількості запізнень за місяць (за даними записів у навчальному журналі) у школярів.

Вихідні дані представлені у таблиці:

|

№ |

Дані за рівнем IQ (x) |

Дані щодо кількості запізнень (y) |

|

Сума |

1122 |

|

|

Середнє арифметичне |

112,2 |

Щоб дати правильну інтерпретацію отриманого показника, необхідно проаналізувати знак коефіцієнта кореляції (+ або -) та його абсолютне значення (за модулем).

Відповідно до таблиці класифікації коефіцієнта кореляції за силою робимо висновок у тому, rxy = -0,827 – це сильна негативна кореляційна залежність. Таким чином, кількість запізнень школярів має дуже сильну залежність від рівня інтелектуального розвитку. Можна сміливо сказати, що учні з високим рівнем IQ спізнюються рідше заняття, ніж учні з низьким IQ.

Коефіцієнт кореляції може застосовуватися як вченими для підтвердження або спростування припущення про залежність двох величин або явищ та виміру її сили, значущості, так і студентами для проведення емпіричних та статистичних досліджень з різних предметів. Необхідно пам'ятати, що цей показник не є ідеальним інструментом, він розраховується лише для вимірювання сили лінійної залежності і завжди буде імовірнісною величиною, яка має певну похибку.

Кореляційний аналіз застосовується у таких областях:

- економічна наука;

- астрофізика;

- соціальні науки (соціологія, психологія, педагогіка);

- агрохімія;

- металознавство;

- промисловість (для контролю за якістю);

- гідробіологія;

- біометрія тощо.

Причини популярності методу кореляційного аналізу:

- Відносна простота розрахунку коефіцієнтів кореляції, для цього не потрібна спеціальна математична освіта.

- Дозволяє розрахувати взаємозв'язки між масовими випадковими величинами, що є предметом аналізу статистичної науки. У зв'язку з цим цей метод набув широкого поширення в галузі статистичних досліджень.

Сподіваюся, тепер ви зможете відрізнити функціональний взаємозв'язок від кореляційного і знатимете, що коли ви чуєте по телебаченню або читаєте в пресі про кореляцію, то під нею мають на увазі позитивну і досить значущу взаємозалежність між двома явищами.

Критерій кореляції Пірсона – це метод параметричної статистики, що дозволяє визначити наявність або відсутність лінійного зв'язку між двома кількісними показниками, а також оцінити її тісноту та статистичну значимість. Іншими словами, критерій кореляції Пірсона дозволяє визначити, чи є лінійний зв'язок між змінами значень двох змінних. У статистичних розрахунках та висновках коефіцієнт кореляції зазвичай позначається як r xyабо R xy.

1. Історія розробки критерію кореляції

Критерій кореляції Пірсона був розроблений командою британських учених на чолі з Карлом Пірсоном(1857-1936) у 90-х роках 19-го століття, для спрощення аналізу коваріації двох випадкових величин. Крім Карла Пірсона над критерієм кореляції Пірсона працювали також Френсіс Еджуорті Рафаель Велдон.

2. Навіщо використовується критерій кореляції Пірсона?

Критерій кореляції Пірсона дозволяє визначити, якою є тіснота (або сила) кореляційного зв'язку між двома показниками, виміряними в кількісній шкалі. За допомогою додаткових розрахунків можна також визначити, наскільки статистично значущий виявлений зв'язок.

Наприклад, за допомогою критерію кореляції Пірсона можна відповісти на питання про наявність зв'язку між температурою тіла та вмістом лейкоцитів у крові при гострих респіраторних інфекціях, між зростанням та вагою пацієнта, між вмістом у питній воді фтору та захворюваністю населення карієсом.

3. Умови та обмеження застосування критерію хі-квадрат Пірсона

- Порівняні показники повинні бути виміряні в кількісній шкалі(наприклад, частота серцевих скорочень, температура тіла, вміст лейкоцитів на 1 мл крові, систолічний артеріальний тиск).

- За допомогою критерію кореляції Пірсона можна визначити лише наявність та силу лінійного взаємозв'язкуміж величинами. Інші характеристики зв'язку, у тому числі напрямок (прямий або зворотний), характер змін (прямолінійний або криволінійний), а також наявність залежності однієї змінної від іншої - визначаються за допомогою регресійного аналізу.

- Кількість зіставлюваних величин має дорівнювати двом. У разі аналізу взаємозв'язку трьох і більше параметрів слід скористатися методом факторного аналізу.

- Критерій кореляції Пірсона є параметричним, у зв'язку з чим умовою його застосування служить нормальний розподілзіставних змінних. У разі потреби кореляційного аналізу показників, розподіл яких відрізняється від нормального, у тому числі виміряних у порядковій шкалі, слід використовувати коефіцієнт рангової кореляції Спірмена.

- Слід чітко розрізняти поняття залежності та кореляції. Залежність величин обумовлює наявність кореляційного зв'язку з-поміж них, але з навпаки.

Наприклад, зростання дитини залежить від її віку, тобто чим старша дитина, тим вона вища. Якщо ми візьмемо двох дітей різного віку, то з високою ймовірністю зростання старшої дитини буде більшим, ніж у молодшого. Це явище і називається залежністю, що передбачає причинно-наслідковий зв'язок між показниками Зрозуміло, між ними є і кореляційний зв'язок, Що означає, що зміни одного показника супроводжуються змінами іншого показника

В іншій ситуації розглянемо зв'язок зростання дитини та частоти серцевих скорочень (ЧСС). Як відомо, обидві ці величини безпосередньо залежать від віку, тому в більшості випадків діти більшого зростання (а значить і старшого віку) матимуть менші значення ЧСС. Тобто, кореляційний зв'язокспостерігатиметься і може мати досить високу тісноту. Однак якщо ми візьмемо дітей одного віку, але різного зростання, то, швидше за все, ЧСС у них буде відрізнятися несуттєво, у зв'язку з чим можна зробити висновок незалежностіЧСС від зростання.

Наведений приклад показує, як важливо розрізняти фундаментальні у статистиці поняття зв'язкуі залежностіпоказників для побудови правильних висновків.

4. Як розрахувати коефіцієнт кореляції Пірсона?

Розрахунок коефіцієнта кореляції Пірсона проводиться за такою формулою:

5. Як інтерпретувати значення коефіцієнта кореляції Пірсона?

Значення коефіцієнта кореляції Пірсона інтерпретуються з його абсолютних значень. Можливі значення коефіцієнта кореляції варіюють від 0 до ±1. Чим більше абсолютне значення r xy – тим вища тіснота зв'язку між двома величинами. r xy = 0 говорить про повну відсутність зв'язку. r xy = 1 – свідчить про наявність абсолютного (функціонального) зв'язку. Якщо значення критерію кореляції Пірсона виявилося більшим за 1 або менше -1 – у розрахунках припущено помилку.

Для оцінки тісноти або сили кореляційного зв'язку зазвичай використовують загальноприйняті критерії, згідно з якими абсолютні значення r xy< 0.3 свидетельствуют о слабкоюзв'язку, значення r xy від 0.3 до 0.7 - про зв'язок середньоїтісноти, значення r xy > 0.7 - про сильноюзв'язку.

Точнішу оцінку сили кореляційного зв'язку можна отримати, якщо скористатися таблицею Чеддока:

Оцінка статистичної значимостікоефіцієнта кореляції r xy здійснюється за допомогою t-критерію, що розраховується за такою формулою:

![]()

Отримане значення t r порівнюється з критичним значенням за певного рівня значущості та кількості ступенів свободи n-2. Якщо t r перевищує t крит, робиться висновок про статистичній значущості виявленого кореляційного зв'язку.

6. Приклад розрахунку коефіцієнта кореляції Пірсона

Метою дослідження стало виявлення, визначення тісноти та статистичної значущості кореляційного зв'язку між двома кількісними показниками: рівнем тестостерону в крові (X) та відсотком м'язової масиу тілі (Y). Вихідні дані для вибірки, що складається з 5 досліджуваних (n = 5), зведені у таблиці.

Коефіцієнт кореляції- Це величина, яка може варіювати в межах від +1 до -1. У разі повної позитивної кореляції цей коефіцієнт дорівнює плюс 1 (говорять про те, що при збільшенні значення однієї змінної збільшується значення іншої змінної), а при повній негативній – мінус 1 (свідчать про зворотний зв'язок, тобто При збільшенні значень однієї змінної, значення іншої зменшуються).

Пр1.:

Пр1.:

Графік залежності сором'язливості та дипресивності. Як бачимо, точки (випробувані) розташовані не хаотично, а вишиковуються навколо однієї лінії, причому, дивлячись на цю лінію можна сказати, що чим у людини виражена сором'язливість, тим більша депресивність, тобто ці явища взаємопов'язані.

Пр2.: Графік для Сором'язливості та Комунікабельності. Ми, що зі збільшенням сором'язливості товариськість зменшується. Їхній коефіцієнт кореляції -0,43. Таким чином, коефіцієнт кореляції більший від 0 до 1 говорить про прямопропорційний зв'язок (чим більше ... тим більше ...), а коефіцієнт від -1 до 0 про зворотний пропорційний (чим більше ... тим менше ...)

Пр2.: Графік для Сором'язливості та Комунікабельності. Ми, що зі збільшенням сором'язливості товариськість зменшується. Їхній коефіцієнт кореляції -0,43. Таким чином, коефіцієнт кореляції більший від 0 до 1 говорить про прямопропорційний зв'язок (чим більше ... тим більше ...), а коефіцієнт від -1 до 0 про зворотний пропорційний (чим більше ... тим менше ...)

Якщо коефіцієнт кореляції дорівнює 0, обидві змінні повністю незалежні один від одного.

Якщо коефіцієнт кореляції дорівнює 0, обидві змінні повністю незалежні один від одного.

Кореляційний зв'язок- це зв'язок, де вплив окремих чинників проявляється лише як тенденція (загалом) при масовому спостереженні фактичних даних. Прикладами кореляційної залежності можуть бути залежності між розмірами активів банку та сумою прибутку банку, зростанням продуктивності праці та стажем роботи працівників.

Використовується дві системи класифікації кореляційних зв'язків за їх силою: загальна та приватна.

Загальна класифікація кореляційних зв'язків: 1) сильна, або тісна за коефіцієнта кореляції r> 0,70; 2) середня при 0,500,70, а не просто кореляція високого рівня значущості.У наведеній нижче таблиці написані назви коефіцієнтів кореляції для різних типів шкал.

| Дихотомічна шкала (1/0) | Рангова (порядкова) шкала | ||

| Дихотомічна шкала (1/0) | Коефіцієнт асоціації Пірсона, коефіцієнт чотириклітинної пари Пірсона. | Бісеріальна кореляція | |

| Рангова (порядкова) шкала | Рангово-бісеріальна кореляція. | Ранговий коефіцієнт кореляції Спірмена чи Кендала. | |

| Інтервальна та абсолютна шкала | Бісеріальна кореляція | Значення інтервальної шкали перетворюються на ранги і використовується ранговий коефіцієнт | Коефіцієнт кореляції Пірсона (коефіцієнт лінійної кореляції) |

При r=0 лінійний кореляційний зв'язок відсутній. У цьому групові середні змінних збігаються зі своїми загальними середніми, а лінії регресії паралельні осям координат.

Рівність r=0 говорить лише про відсутність лінійної кореляційної залежності (некорелювання змінних), але не взагалі про відсутність кореляційної, а тим більше, статистичної залежності.

Іноді висновок про відсутність кореляції важливіше за наявність сильної кореляції. Нульова кореляція двох змінних може свідчити, що жодного впливу однієї змінної іншу немає, за умови, що ми довіряємо результатам вимірів.

У SPSS: 11.3.2 Коефіцієнти кореляції

Досі ми з'ясовували лише факт існування статистичної залежності між двома ознаками. Далі ми спробуємо з'ясувати, які висновки можна зробити про силу чи слабкість цієї залежності, а також про її вид та спрямованість. Критерії кількісної оцінки залежності між змінними називаються коефіцієнтами кореляції чи заходами зв'язаності. Дві змінні корелюють між собою позитивно, якщо між ними існує пряме, односпрямоване співвідношення. При односпрямованому співвідношенні малі значення однієї змінної відповідають малим значенням іншої змінної, більші значення – більшим. Дві змінні корелюють між собою негативно, якщо між ними існує зворотне, різноспрямоване співвідношення. При різноспрямованому співвідношенні малі значення однієї змінної відповідають більшим значенням іншої змінної та навпаки. Значення коефіцієнтів кореляції завжди лежать у діапазоні від -1 до +1.

Як коефіцієнт кореляції між змінними, що належать порядковій шкалі, застосовується коефіцієнт Спірмена, а для змінних, що належать до інтервальної шкали - коефіцієнт кореляції Пірсона (момент творів). При цьому слід врахувати, що кожну дихотомічну змінну, тобто змінну, що належить до номінальної шкали та має дві категорії, можна розглядати як порядкову.

Для початку ми перевіримо, чи існує кореляція між змінними sex і psyche з файлу studium.sav. При цьому ми врахуємо, що дихотомічну змінну sex можна вважати порядковою. Виконайте наступні дії:

· Виберіть у меню команди Analyze (Аналіз) Descriptive Statistics (Дескриптивні статистики) Crosstabs... (Таблиці сполучення)

· Перенесіть змінну sex до списку рядків, а змінну psyche – до списку стовпців.

· Натисніть кнопку Statistics... (Статистика). У діалоговому вікні Crosstabs: Statistics встановіть прапорець Correlations (Кореляції). Виберіть кнопкою Continue.

· У діалозі Crosstabs відмовтеся від виведення таблиць, встановивши прапорець Supress tables (Пригнічувати таблиці). Натисніть кнопку ОК.

Буде обчислено коефіцієнти кореляції Спірмена та Пірсона, а також проведено перевірку їх значущості:

/ СПСС 10

Завдання №10 Кореляційний аналіз

Поняття кореляції

Кореляція чи коефіцієнт кореляції – це статистичний показник імовірніснийзв'язку між двома змінними, виміряними за кількісними шкалами. На відміну від функціонального зв'язку, при якому кожному значенню однієї змінної відповідає суворо визначенезначення іншої змінної, імовірнісний зв'язокхарактеризується тим, що кожному значенню однієї змінної відповідає безліч значеньІншою змінною, Прикладом імовірнісного зв'язку є зв'язок між зростанням і вагою людей. Зрозуміло, що той самий зріст може бути у людей різної ваги і навпаки.

Кореляція є величиною, укладеною в межах від -1 до + 1, і позначається буквою r. Причому, якщо значення знаходиться ближче до 1, це означає наявність сильного зв'язку, а якщо ближче до 0, то слабкої. Значення кореляції менше 0,2 сприймається як слабка кореляція, понад 0,5 – висока. Якщо коефіцієнт кореляції негативний, це означає наявність зворотний зв'язок: що стоїть значення однієї змінної, тим нижче значення інший.

Залежно від значень коефіцієнта rможна виділити різні види кореляції:

Сувора позитивна кореляціявизначається значенням r = 1. Термін «строга» означає, що значення однієї змінної однозначно визначаються значеннями іншої змінної, а термін « позитивна» -що зі зростанням значень однієї змінної значення інший змінної також зростають.

Сувора кореляція є математичною абстракцією і не зустрічається у реальних дослідженнях.

Позитивна кореляціявідповідає значенням 0

Відсутність кореляціївизначається значенням r = 0. Нульовий коефіцієнт кореляції свідчить, що значення змінних не пов'язані між собою.

Відсутність кореляції H o : 0 r xy =0 формулюється як відображення нульовийгіпотези у кореляційному аналізі.

Негативна кореляція: -1

Сувора негативна кореляціявизначається значенням r = -1. Вона також, як і сувора позитивна кореляція, є абстракцією і не знаходить вираження у практичних дослідженнях.

Таблиця 1

Види кореляції та їх визначення

Метод обчислення коефіцієнта кореляції залежить від виду шкали, за якою виміряно значення змінної.

Коефіцієнт кореляції rПірсонає основним і може використовуватися для змінних з номінальною та частково впорядкованою, інтервальними шкалами, розподіл значень за якими відповідає нормальному (кореляція моментів твору). Коефіцієнт кореляції Пірсона дає досить точні результати у випадках анормальних розподілів.

Для розподілів, що не є нормальними, краще користуватися коефіцієнтами рангової кореляції Спірмена та Кендала. Ранговими вони є тому, що програма попередньо ранжує змінні, що корелюються.

Кореляцію rСпірмена програма SPSS обчислює наступним чином: спочатку змінні переводяться в ранги, а потім до рангів застосовується формула Пірсона.

В основі кореляції, запропонованої М. Кендал, лежить ідея про те, що про напрям зв'язку можна судити, попарно порівнюючи між собою піддослідних. Якщо у пари перевірених змін по Х збігаються у напрямку зі зміною по Yзбігається, це свідчить про позитивний зв'язок. Якщо не збігається – то про негативний зв'язок. Цей коефіцієнт застосовується переважно психологами, які працюють із малими вибірками. Оскільки соціологи працюють із великими масивами даних, то перебір пар, виявлення різниці відносних частот та інверсій всіх пар піддослідних у вибірці скрутний. Найбільш поширеним є коеф. Пірсон.

Оскільки коефіцієнт кореляції rПірсона є основним і може використовуватися (з деякою похибкою залежно від типу шкали та рівня анормальності у розподілі) для всіх змінних, виміряних за кількісними шкалами, розглянемо приклади його використання та порівняємо отримані результати з результатами вимірювань за іншими коефіцієнтами кореляції.

Формула обчислення коефіцієнта r- Пірсона:

r xy = ∑ (Xi-Xср)∙(Yi-Yср) / (N-1)∙σ x ∙σ y ∙

Де: Xi, Yi- Значення двох змінних;

Xср, Yср-середні значення двох змінних;

σ x , σ y – стандартні відхилення,

N-кількість спостережень.

Парні кореляції

Наприклад, ми хотіли б з'ясувати, як співвідносяться відповіді між різними видами традиційних цінностей у уявленнях студентів про ідеальне місце роботи (змінні: а9.1, а9.3, а9.5, а9.7), а потім про співвідношення ліберальних цінностей (а9 .2, а9.4, а9.6, а9.8) . Дані змінні виміряні по 5-членним впорядкованим шкалам.

Використовуємо процедуру: «Аналіз», «Кореляції», «Парні». За замовчуванням коеф. Пірсона встановлено у діалоговому вікні. Використовуємо коеф. Пірсона

У вікно відбору переносяться перемінні, що тестуються: а9.1, а9.3, а9.5, а9.7

Шляхом натискання ОК отримуємо розрахунок:

Кореляції

|

а9.1.т. Наскільки важливо мати достатньо часу для сім'ї та особистого життя? |

Кореляція Пірсона |

||||

|

Знч.(2-сторон) |

|||||

|

а9.3.т. Наскільки важливо не боятися втратити свою роботу? |

Кореляція Пірсона |

||||

|

Знч.(2-сторон) |

|||||

|

а9.5.т. Наскільки важливо мати такого начальника, який радитиметься з Вами, приймаючи те чи інше рішення? |

Кореляція Пірсона |

||||

|

Знч.(2-сторон) |

|||||

|

а9.7.т. Наскільки важливо працювати у злагодженому колективі, відчувати себе його частиною? |

Кореляція Пірсона |

||||

|

Знч.(2-сторон) |

|||||

** Кореляція значуща лише на рівні 0.01 (2-сторон.).

Таблиця кількісних значень збудованої кореляційної матриці

Приватні кореляції:

Для початку збудуємо парну кореляцію між зазначеними двома змінними:

|

Кореляції |

|||

|

с8. Відчувають близькість із тими, хто живе поруч із вами, сусідами |

Кореляція Пірсона |

||

|

Знч.(2-сторон) |

|||

|

с12. Відчувають близькість зі своєю родиною |

Кореляція Пірсона |

||

|

Знч.(2-сторон) |

|||

|

**. Кореляція значуща лише на рівні 0.01 (2-сторон.). |

|||

Потім використовуємо процедуру побудови приватної кореляції: «Аналіз», «Кореляції», «Приватні».

Припустимо, що цінність «Важливо самостійно визначати та змінювати порядок своєї роботи» у взаємозв'язку із зазначеними змінними виявиться тим вирішальним фактором, під вплив якого раніше виявлений зв'язок зникне, або виявиться малозначущою.

|

Кореляції |

||||

|

Виключені змінні |

с8. Відчувають близькість із тими, хто живе поруч із вами, сусідами |

с12. Відчувають близькість зі своєю родиною |

||

|

с16. Відчувають близькість з людьми, які мають той самий достаток, що й ви |

с8. Відчувають близькість із тими, хто живе поруч із вами, сусідами |

Кореляція |

||

|

Значимість (2-сторон.) |

||||

|

с12. Відчувають близькість зі своєю родиною |

Кореляція |

|||

|

Значимість (2-сторон.) |

||||

Як очевидно з таблиці під впливом контрольної змінної зв'язок дещо знизилася: з 0, 120 до 0, 102. Проте, це зниження зниження дозволяє стверджувати, що рані виявлена зв'язок є відбитком помилкової кореляції, т.к. вона залишається досить високою і дає змогу з нульовою похибкою спростовувати нульову гіпотезу.

Коефіцієнт кореляції

Найбільш точний спосіб визначення тісноти та характеру кореляційного зв'язку - знаходження коефіцієнта кореляції. Коефіцієнт кореляції є число, що визначається за формулою:

де r ху – коефіцієнт кореляції;

x i -значення першої ознаки;

у i-значення другої ознаки;

Середня арифметична значень першої ознаки

Середня арифметична значень другої ознаки

Для користування формулою (32) побудуємо таблицю, яка забезпечить необхідну послідовність у підготовці чисел для знаходження чисельника та знаменника коефіцієнта кореляції.

Як видно з формули (32), послідовність дій така: знаходимо середні арифметичні обох ознак х і у, знаходимо різницю між значеннями ознаки та її середньої (х і - ) та у і - ), потім знаходимо їх твір (х і - ) у і - ) – сума останніх дає чисельник коефіцієнта кореляції. Для знаходження його знаменника слід різниці (x i -) і (у і -) звести в квадрат, знайти їх суми та витягти корінь квадратний з їхнього твору.

Так приклад 31 знаходження коефіцієнта кореляції відповідно до формули (32) можна подати наступним чином (табл. 50).

Отримане число коефіцієнта кореляції дає можливість встановити наявність, тісноту та характер зв'язку.

1. Якщо коефіцієнт кореляції дорівнює нулю, зв'язок між ознаками відсутній.

2. Якщо коефіцієнт кореляції дорівнює одиниці, зв'язок між ознаками настільки великий, що перетворюється на функціональну.

3. Абсолютна величина коефіцієнта кореляції не виходить за межі інтервалу від нуля до одиниці:

Це дає можливість орієнтуватися на тісноту зв'язку: чим величина коефіцієнта ближче до нуля, тим зв'язок слабший, чим ближче до одиниці, тим зв'язок тісніше.

4. Знак коефіцієнта кореляції "плюс" означає пряму кореляцію, знак "мінус"-зворотну.

Таблиця 50

| х і | у і | (х і -) | (у і -) | (х і -) (у і -) | (х і -) 2 | (у і - )2 |

| 14,00 | 12,10 | -1,70 | -2,30 | +3,91 | 2,89 | 5,29 |

| 14,20 | 13,80 | -1,50 | -0,60 | +0,90 | 2,25 | 0,36 |

| 14,90 | 14,20 | -0,80 | -0,20 | +0,16 | 0,64 | 0,04 |

| 15,40 | 13,00 | -0,30 | -1,40 | +0,42 | 0,09 | 1,96 |

| 16,00 | 14,60 | +0,30 | +0,20 | +0,06 | 0,09 | 0,04 |

| 17,20 | 15,90 | +1,50 | +2,25 | 2,25 | ||

| 18,10 | 17,40 | +2,40 | +2,00 | +4,80 | 5,76 | 4,00 |

| 109,80 | 101,00 | 12,50 | 13,97 | 13,94 |

Отже, обчислений прикладі 31 коефіцієнт кореляції r xy = +0,9. дозволяє зробити такі висновки: існує кореляційний зв'язок між величиною м'язової сили правої та лівої кистей у досліджуваних школярів (коефіцієнт r xy =+0,9 відмінний від нуля), зв'язок дуже тісний (коефіцієнт r xy =+0,9 близький до одиниці), кореляція пряма (коефіцієнт r xy = +0,9 позитивний), т. Е. Зі збільшенням м'язової сили однієї з кистей збільшується сила іншої кисті.

При обчисленні коефіцієнта кореляції та користуванні його властивостями слід врахувати, що висновки дають коректні результати у тому випадку, коли ознаки розподілені нормально та коли розглядається взаємозв'язок між великою кількістю значень обох ознак.

У розглянутому прикладі 31 аналізовано лише 7 значень обох ознак, що, звичайно, недостатньо для подібних досліджень. Нагадуємо тут ще раз, що приклади, у цій книзі взагалі й у цьому розділі зокрема, мають характер ілюстрації методів, а чи не докладного викладу будь-яких наукових експериментів. Внаслідок цього розглянуто невелику кількість значень ознак, виміри округлені - все це робиться для того, щоб громіздкими обчисленнями не затемнювати ідею методу.

Особливу увагу слід звернути на істоту взаємозв'язку, що розглядається. Коефіцієнт кореляції неспроможна призвести до правильних результатів дослідження, якщо аналіз взаємозв'язку між ознаками проводиться формально. Повернемося ще раз до прикладу 31. Обидві розглянуті ознаки являли собою значення м'язової сили правої та лівої кистей. Уявімо, що під ознакою xi у прикладі 31 (14,0; 14,2; 14,9... ...18,1) ми розуміємо довжину випадково спійманих риб у сантиметрах, а під ознакою у і (12,1) ; 13,8;14,2... ...17,4) -вага приладів в лабораторії в кілограмах. Формально скориставшись апаратом обчислень знаходження коефіцієнта кореляції і отримавши у разі також r xy =+0>9, ми мали укласти, що з довжиною риб і вагою приладів існує тісний зв'язок прямого характеру. Безглуздість такого висновку є очевидною.

Щоб уникнути формального підходу до користування коефіцієнтом кореляції, слід будь-яким іншим методом – математичним, логічним, експериментальним, теоретичним – виявити можливість існування кореляційного зв'язку між ознаками, тобто виявити органічну єдність ознак. Тільки після цього можна приступати до користування кореляційним аналізом та встановлювати величину та характер взаємозв'язку.

У математичній статистиці існує ще поняття множинної кореляції- взаємозв'язку між трьома та більше ознаками. У цих випадках користуються коефіцієнтом множинної кореляції, що складається з парних коефіцієнтів кореляції, описаних вище.

Наприклад, коефіцієнт кореляції трьох ознак-х і , у і , z і - є:

де R xyz -коефіцієнт множинної кореляції, що виражає, як ознака х i залежить від ознак у і і z i;

r xy -коефіцієнт кореляції між ознаками x i та y i ;

r xz -коефіцієнт кореляції між ознаками Xi та Zi;

r yz - коефіцієнт кореляції між ознаками y i , z i

Кореляційний аналіз це:

Кореляційний аналізКореляція- статистичний взаємозв'язок двох або кількох випадкових величин (або величин, які можна з деяким допустимим ступенем точності вважати такими). При цьому, зміни однієї або декількох цих величин призводять до систематичної зміни інший або інших величин. Математичною мірою кореляції двох випадкових величин служить коефіцієнт кореляції.

Кореляція може бути позитивною та негативною (можлива також ситуація відсутності статистичного взаємозв'язку – наприклад, для незалежних випадкових величин). Негативна кореляція - кореляція, при якій збільшення однієї змінної пов'язане із зменшенням іншої змінної, при цьому коефіцієнт кореляції негативний. Позитивна кореляція - кореляція, при якій збільшення однієї змінної пов'язане зі збільшенням іншої змінної, при цьому коефіцієнт кореляції є позитивним.

Автокореляція - Статистичний взаємозв'язок між випадковими величинами з одного ряду, але взятих зі зрушенням, наприклад, для випадкового процесу - зі зрушенням за часом.

Метод обробки статистичних даних, що полягає у вивченні коефіцієнтів (кореляції) між змінними, називається кореляційним аналізом.

Коефіцієнт кореляції

Коефіцієнт кореляціїабо парний коефіцієнт кореляціїТеоретично ймовірностей і статистиці - це показник характеру зміни двох випадкових величин. Коефіцієнт кореляції позначається латинською літерою R і може набувати значень між -1 і +1. Якщо значення по модулю знаходиться ближче до 1, це означає наявність сильного зв'язку (при коефіцієнті кореляції рівному одиниці говорять про функціональний зв'язок), а якщо ближче до 0, то слабкої.

Коефіцієнт кореляції Пірсона

Для метричних величин застосовується коефіцієнт кореляції Пірсона, точна формула якого була введена Френсісом Гальтоном:

Нехай X,Y- дві випадкові величини, визначені одному імовірнісному просторі. Тоді їхній коефіцієнт кореляції задається формулою:

,

,

де cov позначає коваріацію, а D - дисперсію, або, що те саме,

,де символ означає математичне очікування.

Для графічного представлення подібного зв'язку можна використовувати прямокутну систему координат з осями, які відповідають обох змінних. Кожна пара значень маркується за допомогою певного символу. Такий графік називається "діаграмою розсіювання".

Метод обчислення коефіцієнта кореляції залежить від виду шкали, до якої належать змінні. Так, для вимірювання змінних з інтервальною та кількісною шкалами необхідно використовувати коефіцієнт кореляції Пірсона (кореляція моментів творів). Якщо щонайменше одна з двох змінних має порядкову шкалу або не є нормально розподіленою, необхідно використовувати рангову кореляцію Спірмена або τ (тау) Кендалу. Якщо одна з двох змінних є дихотомічною, використовується точкова дворядна кореляція, а якщо обидві змінні є дихотомічними: чотирипольова кореляція. Розрахунок коефіцієнта кореляції між двома недихотомічними змінними не позбавлений сенсу лише тоді, коли зв'язок між ними лінійний (односпрямований).

Коефіцієнт кореляції Кенделла

Використовується для виміру взаємної невпорядкованості.

Коефіцієнт кореляції Спірмена

Властивості коефіцієнта кореляції

- Нерівність Коші – Буняковського:

Кореляційний аналіз

Кореляційний аналіз- метод обробки статистичних даних, що полягає у вивченні коефіцієнтів ( кореляції) між змінними. При цьому порівнюються коефіцієнти кореляції між однією парою або безліччю пар ознак для встановлення між ними статистичних взаємозв'язків.

Ціль кореляційного аналізу- Забезпечити отримання деякої інформації про одну змінну за допомогою іншої змінної. У випадках, коли можливе досягнення мети, кажуть, що змінні корелюють. В самому загальному виглядіприйняття гіпотези про наявність кореляції означає, що зміна значення змінної А, відбудеться одночасно з пропорційною зміною значення Б: якщо обидві змінні зростають то кореляція позитивнаякщо одна змінна зростає, а друга зменшується, кореляція негативна.

Кореляція відбиває лише лінійну залежність величин, але з відбиває їх функціональної зв'язності. Наприклад, якщо визначити коефіцієнт кореляції між величинами A = sin(x) та B = cos(x), він буде близький до нуля, т. е. залежність між величинами відсутня. Тим часом, величини A та B очевидно пов'язані функціонально за законом sin 2(x) + cos 2(x) = 1.

Обмеження кореляційного аналізу

Графіки розподілів пар (x, y) з відповідними коефіцієнтами кореляцій x та y для кожного з них. Зверніть увагу, що коефіцієнт кореляції відображає лінійну залежність (верхній рядок), але не визначає криву залежності (середній рядок), і зовсім не підходить для опису складних, нелінійних залежностей (нижній рядок).

Графіки розподілів пар (x, y) з відповідними коефіцієнтами кореляцій x та y для кожного з них. Зверніть увагу, що коефіцієнт кореляції відображає лінійну залежність (верхній рядок), але не визначає криву залежності (середній рядок), і зовсім не підходить для опису складних, нелінійних залежностей (нижній рядок). - Застосування можливе у разі достатньої кількості випадків вивчення: для конкретного виду коефіцієнта кореляції становить від 25 до 100 пар спостережень.

- Друге обмеження випливає з гіпотези кореляційного аналізу, на яку закладено лінійна залежність змінних. У багатьох випадках, коли достовірно відомо, що залежність існує, кореляційний аналіз може дати результатів просто з огляду на те, що залежність нелінійна (виражена, наприклад, як параболи).

- Сам собою факт кореляційної залежності не дає підстави стверджувати, яка зі змінних передує або є причиною змін, або що змінні взагалі причинно пов'язані між собою, наприклад, через дії третього фактора.

Галузь застосування

Даний метод обробки статистичних даних дуже популярний в економіці та соціальних науках (зокрема в психології та соціології), хоча сфера застосування коефіцієнтів кореляції велика: контроль якості промислової продукції, металознавство, агрохімія, гідробіологія, біометрія та інші.

Популярність методу обумовлена двома моментами: коефіцієнти кореляції щодо прості у підрахунку, їх застосування вимагає спеціальної математичної підготовки. У поєднанні з простотою інтерпретації, простота застосування коефіцієнта призвела до його поширення у сфері аналізу статистичних даних.

Хибна кореляція

Часто приваблива простота кореляційного дослідження підштовхує дослідника робити помилкові інтуїтивні висновки про наявність причинно-наслідкового зв'язку між парами ознак, тоді як коефіцієнти кореляції встановлюють лише статистичні взаємозв'язки.

У сучасній кількісній методології соціальних наук фактично відбулася відмова від спроб встановити причинно-наслідкові зв'язки між спостережуваними змінними емпіричними методами. Тому, коли дослідники у соціальних науках говорять про встановлення взаємозв'язків між досліджуваними змінними, мається на увазі або загальнотеоретичне припущення, або статистична залежність.

Див. також

- Автокореляційна функція

- Взаємнокореляційна функція

- Коваріація

- Коефіцієнт детермінації

- Регресійний аналіз

Wikimedia Foundation. 2010 року.